Portrait de Sam Altman par Stable Diffusion (contenant un casse-tête pour dactylophiles)

Vous vous souvenez sans doute de la révolution de palais ratée chez OpenAI le 17 novembre de l’année dernière quand le patron, Sam Altman, après avoir été renversé, avait été réintégré quelques jours plus tard, le 21, après avoir reçu le soutien de 97% des membres du personnel menaçant de démissionner s’il ne reprenait pas les rênes du pouvoir.

L’un des responsables du coup était Ilya Sutskever, ancien élève de Geoffrey Hinton le « parrain » des Grands Modèles de Langage. Sutskever, rejoignant le camp des mutins après avoir perdu, avait fait son mea culpa. Ce revirement post-défaite ne lui a apparemment pas fait beaucoup de bien puisqu’on est sans nouvelle de lui depuis lors.

Sutskever était lié au mouvement « effective altruism » prônant à ses sectateurs de faire le plus d’argent possible pour le redistribuer ensuite … aux pauvres. Dans la pratique, les choses ne sont pas aussi simples puisque le plus gros de l’argent légué par les fidèles se retrouve financer des organismes de promotion de … l’altruisme efficace en question. Le plus connu des membres de cette secte n’est autre que Sam Bankman Fried, empereur à une époque du monde des jetons commercialisables surnommés « cryptomonnaies », désormais sous les verrous pour 25 ans en raison de l’évaporation mystérieuse de milliards de dollars passés entre ses mains.

Autre fait significatif relatif à Sutskever, il était à la tête de l’effort dit de « superalignement » au sein de la compagnie OpenAI, tentative de mettre sur pied une méthode infaillible pour que l’IA, aussi intelligente qu’elle puisse devenir, ne déraille jamais de la voie ferrée que nous autres humains lui avons tracée. Fait significatif parce que parmi les objectifs de l’« effective altruism » se trouve en particulier celui d’empêcher l’apparition d’une « AGI », intelligence artificielle généraliste, tous les moyens étant permis pour prévenir cette horreur, en particulier l’établissement d’un gouvernement mondial avec chef suprême assuré de droits dictatoriaux comme celui d’arrêter les chefs d’État qui permettraient l’apparition de l’intelligence artificielle généraliste sur le territoire de leur nation (sic).

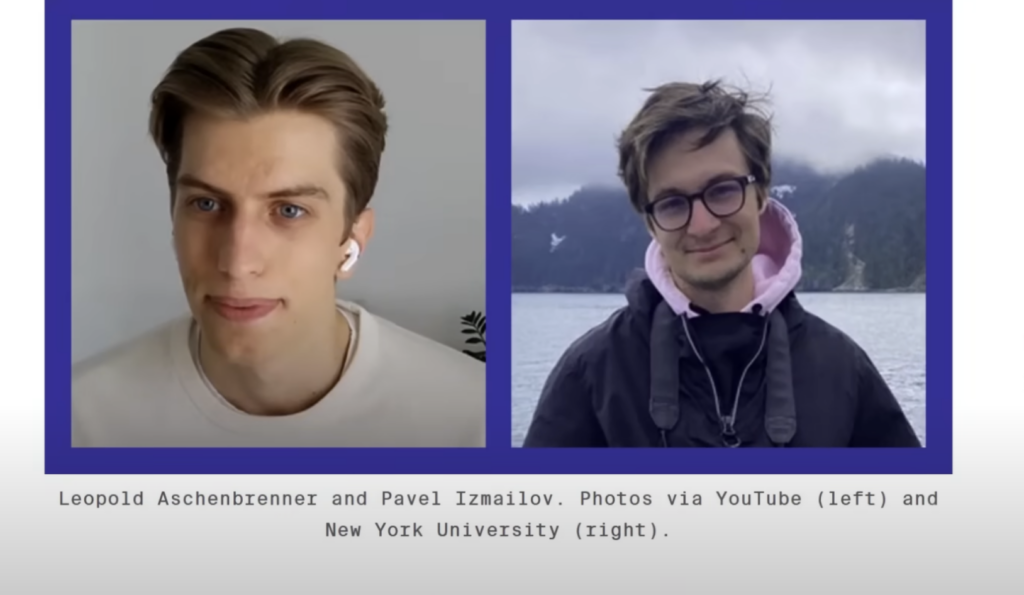

Tout cela semblerait éminemment saugrenu s’il n’y avait deux choses : d’une part, le procès intenté à OpenAI par Elon Musk, sectateur fervent de l’altruisme efficace, la firme de San Francisco promouvant selon lui secrètement l’advenue de … l’intelligence artificielle généraliste, Musk à qui il est reproché par ailleurs au niveau des gouvernements nationaux de se promouvoir aujourd’hui en chef suprême, de facto arbitre en particulier du conflit russo-ukrainien, d’autre part, le limogeage, appris le 11 avril, de deux collaborateurs de OpenAI : Leopold Aschenbrenner and Pavel Izmailov, dont voici les portraits :

Tout (ou presque) s’éclaire quand on apprend que « M. Aschenbrenner faisait partie de l’équipe de superalignement d’OpenAI, chargée de veiller à ce que ses recherches ne créent pas par inadvertance une intelligence artificielle générale ‘superintelligente’ », équipe du superalignement à laquelle M. Izmailov avait également appartenu. Mais ce n’est pas tout : « M. Aschenbrenner avait des liens avec le mouvement de l’altruisme efficace qui accorde la priorité à la maîtrise des dangers liés à l’intelligence artificielle » (The Information).

Si tout cela vous paraît encore désespérément opaque, j’espère que la lumière se fera lorsque vous aurez relu ce que j’écrivais à propos d’OpenAI et de l’« effective altruism » dans l’article que j’ai publié dans AOC le 6 mars dernier, Le prince et l’honnête homme face à la Singularité :

… le board d’OpenAI constituait en l’occasion un microcosme, les protagonistes incarnant les diverses motivations du Prince et de l’honnête homme et, en l’occurence, de manière éclatée et recomposée parmi les acteurs en présence, le tableau étant simplifié du fait que plusieurs de ces actrices et acteurs se voyaient dans le rôle de militants d’une idéologie se situant de manière explicite au cœur des enjeux opposant le Prince et les honnêtes hommes : l’effective altruism.

L’effective altruism est une philosophie née dans le monde anglo-saxon au confluent de l’utilitarisme et du libertarianisme avec une forte composante altruiste importée des Évangiles. La jauge de cet « altruisme efficace » est la quantité de bien induit au sein de la communauté dans son ensemble par ses adeptes, le moyen mobilisé par ceux-ci pour le réaliser étant l’argent : c’est leur fortune qui permet cette optimisation supposée du bien, une conception entièrement dans la ligne historique du calvinisme selon lequel la prédestination individuelle trouve sa confirmation dans la capacité à faire de l’argent.

L’effective altruism, « produit de niche » jusque-là, a fait la une de l’actualité quand il est apparu qu’il était le moteur de FTX, une bourse de ces jetons commercialisables que l’on qualifie pompeusement de « cryptomonnaies » qui connut une banqueroute retentissante, ses deux piliers, Sam Bankman-Fried à la tête de FTX et Caroline Ellison à la tête du fonds jumeau Alameda, étant apôtres du mouvement. Apparut alors en surface qu’une philosophie de « la fin veut les moyens » sous-tendait l’effective altruism de philanthropes par trop bienveillants et que les considérations d’ordre éthique avaient été mises entre parenthèses par ces nouveaux princes libertariens sous prétexte d’efficacité. L’hybris de tels personnages à l’Ego surdimensionné avait pu exercer ses ravages dans la communauté à hauteur de leur fortune dont le caractère potentiellement illimité était justifié à leurs yeux par l’abondance de bienfaits dont elle était potentiellement la source. On ne s’étonnera pas qu’Elon Musk, milliardaire fondateur de la firme automobile Tesla, de l’entreprise spatiale SpaceX, nouveau propriétaire de Twitter rebaptisé « X » par lui, également à la tête du projet d’implantation de puces électroniques dans le cerveau Neuralink, soit un autre promoteur du mouvement, qui a déclaré à son propos qu’il est : « en correspondance étroite avec ma propre philosophie » *.

Or, l’effective altruism et l’intelligence artificielle ne font pas bon ménage. Sam Altman a déclaré à propos du premier qu’il constituait un « mouvement incroyablement défectueux » affichant un « comportement émergent très bizarre ». Ce mouvement a déjà consacré des sommes considérables à promouvoir la méfiance envers l’intelligence artificielle, agitant le spectre de catastrophes sans nom, défiance dont on pourrait soupçonner que l’une de ses motivations en tout cas est celle de parer à la perte de pouvoir que signifie l’émergence d’une intelligence supérieure à celle de ces philanthropes, champions sans doute de la bienfaisance à leurs propres yeux, mais mégalomanes narcissiques aux yeux du reste du monde.

Le rappel suivant pouvait être lu dans un article du Wall Street Journal en date du 22 novembre 2023, soit le lendemain du retour de Sam Altman :

« Altman, qui a été licencié par le conseil d’administration vendredi, s’est opposé au scientifique en chef de la société et membre du conseil d’administration, Ilya Sutskever, sur des questions de sécurité de l’IA qui reflétaient les préoccupations liées à l’effective altruism, si l’on en croit des personnes familières du conflit.

Ont voté avec Sutskever, qui fut à la tête du coup, les membres du conseil d’administration Tasha McCauley, cadre dans le monde de la technologie et membre du conseil d’administration de l’organisation caritative Effective Ventures, et Helen Toner, cadre au Centre pour la sécurité et les technologies émergentes de l’université de Georgetown, lequel est soutenu par une philanthropie dédiée aux causes de l’effective altruism. Ils représentaient trois des quatre votes nécessaires à l’éviction de M. Altman, selon des personnes au fait de l’affaire. Le conseil d’administration a déclaré que celui-ci n’avait pas fait preuve d’une ‘franchise constante’ » *.

* Robert McMillan & Deepa Seetharaman, « How a Fervent Belief Split Silicon Valley—and Fueled the Blowup at OpenAI », The Wall Street Journal, le 22 novembre 2023

Portrait d’Elon Musk par Stable Diffusion (frustrant pour les dactylophiles)

Laisser un commentaire